Mainostan häveliäästi tähän perään vielä päivän Varttia, missä käsittelin kriittisen rakentavasti Citrinin skenaariota. ![]()

Anthropicilla on ollut nyt aika paljon häiriöitä. Jossain spekuloitiin sillä olisiko Iranin dronet aiheuttanut ongelmia…

Pääsääntöisestihän tuo uptime näyttää ihan hyvältä että aika hyvin sieltä pitäisi palvelua saada jos lyö euroja tiskiin.

Tämän suhteen kannattaa meistä valkokauluksista jokaisen pohtia paljonko tämä oikeasti vaatii kapaa oikein tehtynä suhteessa siihen paljonko lokaalisti voidaan jo saada aikaan vähäisellä sähkönkulutuksella ja suht edullisella raudalla. Varmasti kaiken korvaamisessa on korkeita ison kitkan kynnyksiä tarjolla vähintään tarpeeksi, mutta eiköhän korvattaviakin duuneja löydy lukumääräisesti melko paljon ja melko helpolla.

Erinomainen rapsa!

Mutta mielestäni jälleen kerran näkökulma on vähän tarpeettoman binäärinen “AI korvaa ihmistyön” -tyyppinen tarkastelu.

Paljon oleellisempaa olisi tarkastella arvosiirtymiä ihmistyöstä tekoälypalveluita tuottaville tahoille tai esimerkiksi toimialojen välillä. Pelkästään näillä on jo mittavia taloudellisia, työelämän rakenteita mullistavia ja mahdollisesti jopa kulttuurillisia sekä sosiaalisia disruptiivisia vaikutuksia.

Työthän eivät ole vielä minkään teknologisen innovaation myötä vähentyneet saati kadonneet. Eiköhän Jehvonsin paradoksi pidä tälläkin kertaa huolen siitä, että kysyntä kasvaa, kun outputin kustannus laskee (olettaen tosiaan, että laskennan marginaalikustannus ei kasva - mitään viitteitähän tällaisesta ei mielestäni ole vaikka analyysirapsasta saa toisen kuvan).

Keyneshän oli laskelmissaan ihan oikeassa, mutta hänen malleistaan puuttuu “rajaton” kasvu. Hän ei nimittäin osannut ottaa huomioon ihmisten halua maksimoida taloudellista hyvinvointia vapaa-ajan kustannuksella. On nimittäin totta, että 1930-luvun output saavutetaan nykyisin aivan murto-osalla siitä työn tuotantopanoksesta, joka tuolloin tarvittiin. Kääntäen, jos olisimme päättäneet pitää outputin vakioisena, työtä tarvitsisi tehdä ehkä vain noin päivä-pari viikossa (lisää tästä Osmo Soininvaaran 2020-luvun yhteiskuntapolitiikka -kirjassa).

Kun miettii, millaisia yhteiskuntataloudellisia mullistuksia teknologinen kehitys vaikkapa 1930-2020 välillä on saanut aikaan (teollinen massatuotanto ja länsimaiden deindustrialisaatio, globalisaatio ja maailmantaloudellinen yhteisriippuvuus ja esim. näistä kaikista suoraan tai välillisesti aiheutuneet myllerrykset), olisin ainakin itse kiinnostunut lukemaan AI:n ennakoiduista vaikutuksista tästä näkökulmasta lopulta paljon enemmän. Fiilis kun on, että tällaisia mylläyksiä saattaa olla edessä nopeastikin - sanotaanko 10-20 v aikaikkunassa - vaikkei AI vähentäisi yhtään työnteon kysyntää vaan jopa lisäisi sitä.

PS. sori jos vastaus kuulostaa kovin kriittiseltä - en osannut sanoittaa ajatuksiani paremmin. Kuten sanoin rapsa oli erinomainen ja kiitos sen nostosta!

Ketjussa taitaa korostua se että täällä on porukkaa AI adoption joka vaiheesta. Ihan alusta alkaen mukana olijoita, ensimmäistä kertaa AI:ta käyttäviä, päivittäin AI työkaluja työssään käyttäviä, ja kaikkia väliltä.

Ainakin omalta osaltani ulospäin ehkä pessimismiltä vaikuttava asenne ei johdu siitä että en uskoisi AI:n tuomaan merkittävään murrokseen. Ihan samalla tavalla kaikki muutkin teknlogiat ovat sen tehneet edellisilläkin kerroilla ja nyt tuo sama pyörä on pyörimässä taas uudestaan. Ihan samalla tavalla kuin internetin alkuaikoina.

Se mikä nyt on erilaista on että tämä adoptiosykli on selkeästi nopeampi kuin edellisillä kerroilla. (Kaikki nopeutuu..) Alkuaikojen ihmettely miten AI:lla voikin tehdä kaikkea meni ohi jo vuosi sitten. Spagettivideot ** ja geneerisen AI materiaalin generointi promptin perusteella, tai yhdistettynä johonkin automaattiseen promptiin on jo nähty. Nyt kyse on siitä miten tämä kaikki saadaan integroitua tuottaviin prosesseihin tuomaan lisäarvoa. Geneerinen “katsokaa mitä mä tein AI:lla” saa aikaan vain silmien pyörittelyä ja äänekkäitä vastalauseita.

Meillä työmaalla AI on jo syönyt kaiken koulutusmateriaalin, skriptiohjeistuksen, data-analyysityökalut, wikisivut ja kaiken muun mihin vain mahdollista päästää käsiksi. Efektiivisesti dedikoiduille AI instansseille (“agenteille”) annetaan valitut kontekstit joiden asiantuntijoita ne ovat ja näitä hyödynnetään ja koulutetaan eteenpäin. Kysymys ei ole siitä että voiko näitä agentteja tehdä tai onko se hyödyllistä, vaan siinä että kuinka nopeasti ja helposti se nykyään onnistuu ihan kaikilta.

Ja tämä kaikki ei vaadi mitään MAG7 organisaatiota vaan kaikki joilla on riittävästi aineistoa tai muuta kontekstia mitä syöttää AI:lle pystyy rakentamaan vastaavaa. Todennäköisesti itsellänikin olisi pihassa joku projektiauto mitä olisin ropaamassa jos joku rakentaisi Claudella agentin joka lukee korjausoppaat ja yhdistää ne internetin keskustelupalstoihin kertyneisiin viisauksiin tarvittavista kiristysmomenteista ja helpoimmista tavoista saada hommat hoidettua.

Mikä itseäni erityisesti tällä hetkellä kiinnostaa on että missä kaikissa muissa konteksteissa AI:n avulla on saatu jotain hyödyllistä aikaiseksi. “Avustaja” agentit on melko peruskauraa ja koodaamisen puolella Claude vie muita aika 6-0. Mutta mitä seuraavaksi?

Ei ole tarkoitus turhaan viilata pilkkua, mutta selkeyden vuoksi ajattelin vain sanoa, ettei kuvaamasi järjestelmä ihan taida olla tekoälyagentti, ainakaan siinä merkityksessä kuin termiä nykyään yleensä käytetään.

LLM, jolle annetaan tietty aineisto tai konteksti (esim. dokumentit, wikit, ohjeet) ja joka vastaa niiden pohjalta kysymyksiin, on pikemminkin konteksti-spesifi chatbot tai RAG-pohjainen assistentti.

Agentilla taas yleensä tarkoitetaan järjestelmää, joka pystyy itsenäisesti tekemään asioita: käyttämään työkaluja, ajamaan komentoja, kirjoittamaan ja suorittamaan koodia jne.

Nyrkkisääntönä:

– jos systeemi vain vastaa kysymyksiin, se ei yleensä ole agentti

– jos systeemi tekee asioita käyttäjän puolesta, sitä yleensä kutsutaan agentiksi

Joo ehkä noi esimerkit oli hieman liian yksinkertaisia. ![]() Yritin korostaa sitä että AI tekeminen on siirtynyt jo siitä että “tehdään AI juttuja” siihen että niitä pitäisi alkaa ajattelemaan ja tekemään teollisemmassa mittakaavassa. Että niillä ratkotaan ihan oikeita ongelmia. Koska tuo alkaa olemaan sitä arkea. Agentti tuli vain yleistermiksi kohtaan “ratkaisu ongelmaan X” ottamatta kantaa interaktiivisuus/proaktiivisuus tasoon.

Yritin korostaa sitä että AI tekeminen on siirtynyt jo siitä että “tehdään AI juttuja” siihen että niitä pitäisi alkaa ajattelemaan ja tekemään teollisemmassa mittakaavassa. Että niillä ratkotaan ihan oikeita ongelmia. Koska tuo alkaa olemaan sitä arkea. Agentti tuli vain yleistermiksi kohtaan “ratkaisu ongelmaan X” ottamatta kantaa interaktiivisuus/proaktiivisuus tasoon.

Niin kauan kuin tokeneita riittää niin todella monia prosesseja on mahdollista oikaista tai helpottaa tavalla tai toisella..

Damodaran oli lukenut Citrinin tuomiopäivän raportin monien muiden tapaan ja pyöritteli sen innoittamana AI:n kehityskulkujen eri skenaariota videon muodossa.

Professori oli jokseenkin samoilla linjoilla kuin esim Verneri aihetta käsittelevässä vartissaan. AI disruptoi, mutta ei lähimainkaan niin nopeasti ja laaja-alaisesti kuin pahimmat skenaariot tällä hetkellä olettaa.

Lopussa oli ihan hauska heitto, kuinka jokaisen kannattaa elää ja kehittyä yksilönä ikään kuin olan takana olisi se AI agentti kirittämässä yrittäen disruptoida kaiken missä olet hyvä😄

Jos AI ei sitten jokaista valkokaulustyöpaikkaa nappaakkaan, niin olet ainakin pirusti parempi siinä mitä teet, kun et ole päässyt matkan varrella laiskistumaan liian tyytyväisenä😄

Mietin tälle sopivaa ketjua mutta kenties tämä on paras. Törmäsin pahamaineisessa X:ssä tällaiseen tutkimukseen viime kesältä.

Tutkimuksen mukaan jo lyhytaikainenkin kielimallien käyttö voi heikentää aivoja. ![]()

Tutkimusryhmä jaettiin kolmeen, joista yksi käytti esseiden laatimiseen kielimalleja, toinen sai käyttää Googlea ja kolmas kirjoitella ihan omalla aivotyöllään. Jo muutamien kuukausien jälkeen aivoskannauksissa oli havaittavissa eroja ryhmien välillä: tekoäly käyttävä porukka suoriutui kaikista heikoiten. Heidän ajattelukyky mahdollisesti rappeutui. ![]()

While LLMs offer immediate convenience, our findings highlight potential cognitive costs. Over four months, LLM users consistently underperformed at neural, linguistic, and behavioral levels. These results raise concerns about the long-term educational implications of LLM reliance and underscore the need for deeper inquiry into AI’s role in learning.

Tavallaan tässä tulee ajatus mieleen, että tekoälyn käyttöä kannattaisi kenties mahdollisuuksien rajoissa rajoittaa omalta osaltaan jos se on mahdollista, ja odottaa lisää tuloksia miten se vaikuttaa ihmisiin. On myös mahdollista, että eri organisaatioissa aletaan heräämään “aivomätään”.

Ja tottakai, aiheesta tarvitaan paljon lisää tutkimuksia. Ei pidä yleistää liikaa esseiden kirjoittamisesta. Mutta intuitiivisesti ajateltuna on loogista, että se mitä ei keho käytä se surkastuu, oli kyse sitten lihaksista tai aivoista.

Lisäys. Tässähän pitää alkaa miettimään tekoälyn “heavy usereita” saman linssin kautta, kuin katsoisi jotain ammattialkoholistia, nyrkkeilijää tai vastaavaa aivoja kuluttavia aktiviteetteja harrastavia ihmisiä. ![]()

Entä tuo kolmikko, päivisin AI-superheavyuser, iltaisin nyrkkeilyharrastaja ja viikonloppuna sitten “nollaus” old-school-tyyliin. ![]()

Juuri näin. Eli jo ilman tutkimuksiakin on selvää, että jos osa ajatustyöstä jätetään jatkossa tekemättä, eivät aivot saa yhtä paljon treeniä kuin ennen ja surkastuvat siihen nähden millaiset ne olivat aiemmalla käyttömäärällä. Kyllähän jo Sokrates muinoin nihkeili jo ihan kirjoitustaidonkin suhteen, koska se vähentää muistamisen ja aivojen käytön tarvetta. Ehkä se oli vielä ihan ok juttu, joten hyvä että ei hiekottanut koko hommaa.

Mutta minusta meillä ihmisilä on mahdollisuus hoitaa tämä oikein niin, että hoitakoon tekoäly sen massajauhamisen ja vähän “ajattelunkin”, mutta emme kuitenkaan ulkoista sitä lopputuloksen tarkistusta ja ymmärrystä ainakaan kokonaan pois ihmiseltä. Niin ei sitten tulla ihan tyhmiksi.

Mikä vois mennä pieleen…?

Listaan kannattaa lisätä ihmiset jotka käyttävät älypuhelinta muuhun kuin soittamiseen tai tekstaamiseen. Sillä on todennetusti hyvin samankaltaisia vaikutuksia kognitiivisiin kykyihin. Hyvä puoli on se, että ainakin älypuhelinten kohdalla käytön lopettamisen jälkeen kyvyt palautuvat melko nopeasti. Kenties tekoälyn kohdalla on samoin.

Sijoitan itse tämän henkisen keskiajan todistusaineiston laariin:

Eipä mikään, sillä eihän kukaan aja esimerkiksi autolla lähikauppaan ostamaan sitä yhtä maitopurkkia, koska mahdollisuus on reippailla omin jaloin ja käyttää samalla lihaksia siihen tarkoitukseen, johon ne on alunperin suunniteltu.

Pitäisikö alkaa sijoittamaan aivokuntosaleihin? Ehkä ihmiset jossain vaiheessa ostavat kausikortteja tilaan, jossa älylaitteet pitää jättää oven ulkopuolelle ja sisällä tehdään asioita vain omia aivoja käyttäen. Siellä on sitten erilaisia treenausvälineitä aina kynästä ja paperista kaikenlaisiin keskittymistä vaativiin älypeleihin, joilla omia aivoja voi vaivata ja yrittää vastustaa työssä tapahtuvaa aivojen surkastumista. Personal Brain Trainerina toimii joku neonörtti, joka on onnistunut itse välttämään täydellisen AI-aivomädän ja osaa laskea sormiensa lisäksi myös varpaansa. ![]()

Aivokuntosalia olisi tarvinnut tämäkin kaveri.

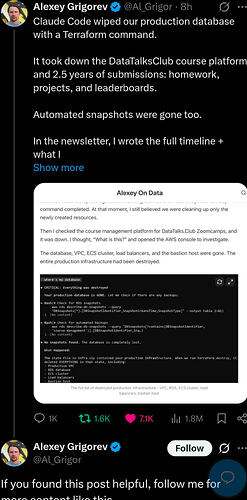

Toi kommentti omaan viestiin “follow me for more content like this” täydentää koko jutun. Samalla laittaa miettimään onko tämä tarina keksitty klikkauksia varten.

Kuka oikeasti antaa AIn riehua ympäristössä jossa se voi saada oikeaa tuhoa aikaiseksi. Tämän rinnalla Metan turkijan inboxin tuhoutuminen tuntuu pikkujutulta.

Ihan normaaliahan tuo nykyään alkaa olemaan ‘ketterilllä’ firmoilla ja henkilökohtaisissa projekteissa, että vedetään tekoälyllä suoraan tuotantoon. Claude ja Codex toimivat parhaiten sellaisissa ympäristöissä missä niillä on mahdollisimman paljon oikeuksia, joten yleinen strategia on antaa niille täysin vapaat kädet ja luottaa siihen, että asioiden mennessä pieleen voit tehdä korjauksen palauttamalla aiemman tilanteen varmuuskopioista. Tässä tapauksessahan käyttäjän kannalta koettu pääongelma oli se, että varmuuskopiot tuhoutuivat eikä se, että koodattiin hyvien toimintatapojen vastaisesti.

Aiemmin työpaikat ovat olleet täynnä 0,5x, 1x ja 2x insinöörejä, sekä muutama 10x insinööri sotkemassa kaikkien elämää, mutta tekoälytyökalujen yleistyessä softankehitykseen alkaa tulla pian mukaan myös 0,1x insinöörejä:

Tarkempi selvitys tilanteesta on täällä:

Itse näen käyttäjän kokemaksi pääongelmaksi sen, että hänen käsityksensä siitä, mitä agentin pitäisi olla tekemässä olivat eri kuin miten agentti tilanteen käsitti. Ja samaan aikaan agentilla oli liikaa oikeuksia tehdä tuhoa. Eli käytännössä hänen kokemuksensa oli se, että agenttia tuli ajettua liian vähällä valvonnalla. Tähän viittaa (kaiken muun linkin takaa löytyvän raportin lisäksi) mielestäni se, mitä muutoksia hän teki / aikoo jatkossa tehdä systeemiinsä:

What Changes Now

The safeguards I implemented are staying.

For Terraform:

- Agents no longer execute commands

- Every plan is reviewed manually

- Every destructive action is run by me

For AI Shipping Labs, I am considering using a separate AWS account for development and production for proper isolation before anything launches.

Mielestäni tässä on paljon yhteistä tarttumapintaa “koodaavien” agenttien ongelmien kanssa. Eli sitten, kun agenttiautomaatio menee pisteeseen, jossa käyttäjä ei enää valvo riittävästi agentille annettuja tehtäviä, niin tilanne sitten joskus eskaloituu sellaiseen suuntaan, jota käyttäjä ei missään tapauksessa toivonut. Tässä tapauksessa ongelmat toki olivat näyttävällä tavalla ilmeisiä, mutta lopputulemana voi tietysti olla paljon hienovaraisempiakin ongelmia, jotka eskaloituvat sitten vasta ajan kanssa sopivan triggerin yhteydessä.

Arvelen, että tällaisia tullaan kokemaan jatkossa enenevässä määrin, kun agenttien käyttö yleistyy. Se agenteilta toivottu jopa 100x tehokkuusparannus toimii erityisesti tähän suuntaan, koska vastaavissa toimissa ihmiskäyttäjä useimmiten ottaa varsin varovaisia askeleita, kun ollaan droppaamassa koko ympäristöä varmuuskopioineen. Agentti tietysti ajaa samalla itseluottamuksella kuin ennenkin, kunhan ensin tehtävän on päätelty olevan juuri se, mitä pitää nyt suorittaa.

Harva vaan viitsii näistä kirjoittaa blogia, eli siitä kyllä pisteet kirjoittajalle. Useimmat tämmöiset harmitukset niellään hiljaa ja niistä ei paljoa muille huudella. Blogiin päätyvät yleensä ne puhtaammat menestystarinat.

Kuka oikeasti antaa AIn riehua ympäristössä jossa se voi saada oikeaa tuhoa aikaiseksi.

Monessa talossa nyt: ‘Gulp!’

Tuotantoympäristön, koodikannan, konfiguroinnin ja eri järjestelmien välisen kommunikaation pitäminen hyvin lapasessa millä tahansa työkalulla, ei ole edelleenkään mikään triviaali tehtävä.

Tuotosten nopea generoiminen edellyttää entistä laadukkaampaa kontrollia ja kovaa osaamista asiantuntijapuolella. Asiakas ei pääsääntöisesti osta koodia vaan 24/7 toimivia järjestelmiä. Asiakasta eivät kiinnosta sinun ongelmasi tai millä keinoilla ne on saatu aikaiseksi. Mutta sitäkin enemmän kiinnostaa milloin tuotannossa esiin tullut ongelma saadaan korjatuksi.

Kuten aina ennenkin, jos joku tuntuu kotikoneella helpolta tehtävältä, sillä ei todennäköisesti myöskään ansaitse mitään; esim. koulutetusta tietomassasta muutamalla kysymyskierroksella generoitu parin modulin sätös. Olisi toki ollut markkinoilla kova juttu 1980-luvulla.

Niinpä. Kun vauhti lisääntyy, niin mahdolliset virheetkin ovat sitten helposti kertaluokkaa näyttävämpiä kuin aiemmin. AI-agentti voi olla terävä työkalu, mutta samasta syystä sillä voi viillellä sitten omat sormensakin, jos käyttää huolimattomasti.

Huolimattomaan käyttöön kuuluvat toki nämä itse promptatut virheet, mutta ehkä pidemmällä tähtäimellä olen vielä enemmän huolissani siitä, miten automaattisia agentteja liitellään rennoin ottein esimerkiksi sähköpostin lukijaksi tai muuten sellaisiksi apureiksi, jotka ovat tavalla tai toisella aktiivisesti yhteydessä ulkomaailmaan. Tuo avaa runsaanpuoleisesti hyökkäyspintaa esimerkiksi erilaisten konteksti-injektioiden muodossa: ei tarvita kuin se yksi onnistunut agentin itsenäisesti lukema injektiosähköposti tai www-sivusto, joka suistaa agentin raiteiltaan, ja sitten se voi alkaa tehdä ihan omiaan kaikkien niiden (todennäköisesti liian suurien) valtuuksien puitteissa, joita sille on annettu.

Eli arvelen, että tämän tyyppiset jutut tulevat yleistymään, kun AI alkaa itsenäisesti häärimään joka puolella (artikkelin arxiv-linkki):

In June 2025, researchers at Aim Security disclosed EchoLeak, a zero-click vulnerability in Microsoft 365 Copilot that allowed a remote attacker to steal confidential data simply by sending an email (Aim Labs 2025). EchoLeak represents the first known case of a prompt injection being weaponized to cause concrete data exfiltration in a production AI system. Without any user interaction, an attacker’s email could coerce Copilot into accessing internal files and transmitting their contents out to an attacker-controlled server. Microsoft assigned CVE-2025-32711 to this flaw and issued emergency patches, underscoring the severity and novelty of the threat (NIST NVD 2025).

Tähän liittyen:

…

A recent study conducted by market research agency 3Gem and flagged by The Register found that business leaders in the United Kingdom seem to be outsourcing a huge amount of their cognitive and emotional labor to their AI chatbots.

The study, which surveyed 200 various owners, founders, CEOs, and other titans of industry, found that 62 percent of the respondents are using AI to make “most decisions.” A whopping 140 of the moguls reported second-guessing their own ideas when they conflicted with AI’s recommendations, while 46 percent said they now rely on advice from AI more than that of their own business colleagues.

This follows a similar report from last year that found 64 percent of business leaders were consulting AI for advice on terminations (although only 27 percent of the respondents to the 3Gem survey said they used AI for those decisions in 2025.)

…

Last year, another joint study conducted by Carnegie Mellon and Microsoft found that knowledge workers who trusted the accuracy of generative AI systems had a lower propensity for critical thought. It’s not hard to see why: when humans are confident that a task has been competently automated, we tend to take a backseat and let the system do its thing — sometimes literally, as in the case of self-driving cars.

That finding was underscored earlier in February, when Søren Dinesen Østergaard, the Danish psychiatrist who predicted the affliction now commonly known as “AI psychosis,” warned that academic scholars risk accruing a “cognitive debt” when they outsource their work to AI chatbots.

All that is to say, there’s a strong consensus that outsourcing your thinking to AI atrophies your brain. The executives who evangelized the lobotomy machine, it seems, are no exception to the rule.

Jos suuri osa toimareista ja vastaavan tason toimijoista ulkoistaa ison osan päätöksentekoa AI:lle, samalla ensisijaisesti epäilee omaa ajatteluaan siinä vaiheessa, kun on eri mieltä AI:n kanssa, sekä preferoi AI:n käyttämistä omien kollegoiden konsultointiin nähden, niin kuka noita firmoja sitten de facto johtaa? Ulkomaisen datakeskuksen algoritmi? Entä miten helpoksi tulee firman päätöksentekoon vaikuttaminen manipuloimalla AI:n toimintaa siellä serveripäässä? No, ilmeisesti varsin helpoksi.

Kiitos kun jaoit, olen miettinyt tuollaista kun höyrypäänä johtajat hypettävät AI:ta mutta tästä on siis olemassa ihan tutkimuskin!

Ruotsalainen valtiomies Axel Oxenstierna tunnetusti rohkaisi kykyjänsä epäröivää poikaansa 30-vuotisen sodan rauhanneuvotteluissa: "Poikani, kunpa tietäisit, miten vähällä järjellä tätä maailmaa hallitaan.”

Neljäsataa vuotta myöhemmin tämä lausahdus resonoi yhä paremmin. ![]()

Lisäys. Pitäisikö sijoittajana ottaa yhdeksi kriteeriksi välttää yhtiöitä, joiden johtjaat käyttävät paljon chatbotteja? Muuttuvatko yhtiöt tyhmemmiksi? ![]()

![0.1x engineer [Office Edition]](https://img.youtube.com/vi/i7aQig-wjYA/maxresdefault.jpg)